2026-04-05_NVDA_Vera-CPU與Agentic時代運算變革

NVIDIA Vera CPU 與 Agentic 時代的運算變革

☘️ Article

癌大觀點

- cpu 近期回到主舞台,訓練時代 gpu 為王是不爭的共識。但走到 agentic 應用,流程、協調、i/o 密集、分支判斷,都是 cpu 發力的地方

- arm, amd, intel 最近的股價也相對硬,不知道東風是否往 cpu 的方向吹了

- ---

- "Chatbot 的工作流程比較簡單:使用者輸入,模型推理,回傳結果。GPU 確實是瓶頸。但在生產環境裡跑的 Agent 是另一回事:接收任務,載入上下文,呼叫模型推理,解析輸出,判斷下一步,呼叫工具 (執行程式碼、查資料庫、發 API 請求),等待工具返回,處理回傳結果,準備下一輪 prompt,再次呼叫模型。如此循環,可能跑幾十輪甚至上百輪。

- 在這個循環裡,模型推理只是其中一個環節,其餘環節全部跑在 CPU 上。

- 訓練和推理是運算密集型任務,天然適合 GPU 的大規模平行架構。但 Agent 的執行邏輯完全不同。

- Agent 本質上是一個長期運作的狀態機。每一步都涉及條件判斷、分支跳轉、外部 I/O、狀態持久化。這些操作有個共同特點:串列的,I/O 密集的,涉及大量小資料搬運而非大矩陣運算。這正好是 CPU 擅長但也容易卡住的領域。

- 用 Amdahl 定律來理解:當 GPU 推理速度提升了一個數量級,整個 pipeline 中 GPU 計算的佔比被急劇壓縮。剩下的串列部分,也就是 CPU 負責的調度、資料預處理、工具呼叫、上下文管理,就成了延遲的主要來源。GPU 越快,這個問題越明顯。

- 軟體層面也在放大這個問題。Python 寫的 Agent 框架 (LangChain、LlamaIndex) 比 Rust 實現的等價方案記憶體消耗高 5 倍,CPU 佔用高 2-3 倍,冷啟動慢 14-34 倍 (source: Benchmark from Saivishwak)。多 Agent 系統更糟:主流框架的 token 重複率在 53%-86% 之間,協調開銷隨 Agent 數量呈現 O(n²) 成長。O'Reilly 的分析是多 Agent 系統的 token 消耗大約是單 agent 的 15 倍,大部分花在了協調上而非實際推理上。

- GPU 是思考引擎,CPU 是執行調度中心。業界把幾乎所有資源都押在思考引擎上,但執行調度中心正在拖後腿了。"

- https://zhuanlan.zhihu.com/p/2017786330097164760

✍️ Abstract

NVIDIA Vera CPU 與 Agentic 時代的運算變革

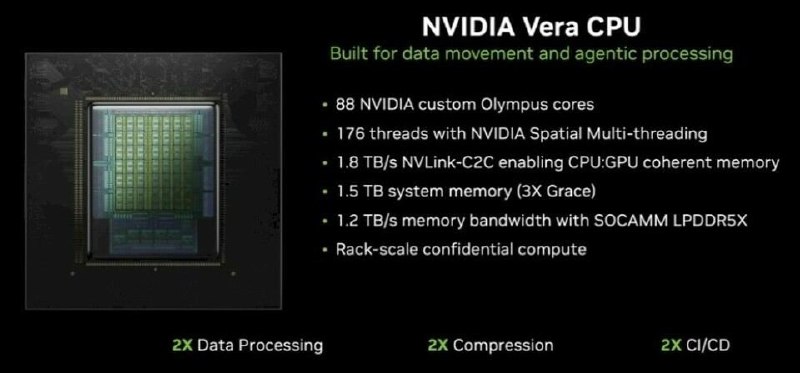

- NVIDIA 發表全新 Vera CPU,專為資料傳輸與代理程式處理 (Agentic Processing) 設計。

- 硬體配置 88 個 NVIDIA 自研 Olympus 核心與 176 個執行緒,支援 NVIDIA 空間多執行緒技術。

- 搭載 1.8 TB/s 的 NVLink-C2C 技術,實現 CPU 與 GPU 之間的快取一致性記憶體存取。

- 提供 1.5 TB 系統記憶體,容量達前代 Grace CPU 的 3 倍,並透過 SOCAMM LPDDR5X 達成 1.2 TB/s 的記憶體頻寬。

- 效能表現上,在資料處理、資料壓縮以及 CI/CD 流程中皆取得 2 倍的提升。

- 支援機櫃級機密運算,強化資料處理安全性。

癌大觀點分析

- 時代切換:訓練時代 GPU 為王,Agentic 應用更吃流程、協調、I/O、分支判斷,CPU 回到主舞台。

- 任務差異:Chatbot 流程短,瓶頸偏 GPU;Agent 流程長,推理只是其中一環。

- Agent 迴圈:接收任務、載入上下文、推理、解析輸出、判斷下一步、呼叫工具、等待回傳、整理結果、組下一輪 Prompt,可能跑數十輪~上百輪。

- CPU 工作:調度、資料預處理、工具呼叫、上下文管理、狀態持久化,幾乎全在 CPU 上跑。

- 工作負載:串列、小資料搬運、外部 I/O 密集,非大矩陣運算,正好對上 CPU 擅長/也容易卡住的區域。

- Amdahl 定律:GPU 推理越快,GPU 佔比越被壓縮,剩下 CPU 串列部分變成主要延遲來源。

- 軟體放大:Python Agent 框架 (LangChain、LlamaIndex) 相對 Rust 等價方案,記憶體消耗高、CPU 佔用高、冷啟動慢。

- 多 Agent 代價:Token 重複率 53%~86%,協調開銷隨 Agent 數量呈 O(n²) 成長,token 消耗可到單 Agent 的 15 倍,主要花在協調。

- 角色比喻:GPU 是思考引擎,CPU 是執行調度中心,資源押注思考引擎過重,調度中心正在拖後腿。

- 市場觀察:Arm、AMD、Intel 股價相對硬,資金風向可能往 CPU 題材靠攏。

專有名詞

- Agentic:代理式應用型態,重點在流程拆解、協調調度、分支判斷、外部 I/O。

- Agent:長期運作的狀態機 (狀態持久化),循環執行任務接收、工具呼叫、結果解析、下一步決策。

- Chatbot:單輪流程,使用者輸入、模型推理、回傳結果,瓶頸更集中在 GPU 推理。

- Workflow (工作流程):多步驟任務鏈,包含上下文載入、Prompt 組裝、工具呼叫、等待回傳、迭代多輪。

- I/O:外部資料交換,如:查資料庫、發 API 請求、檔案讀寫,特性偏串列、小資料搬運。

- GPU:運算加速器,擅長大規模平行、矩陣運算,常是訓練、推理階段的核心瓶頸。

- CPU:執行調度中心,擅長條件判斷、分支跳轉、外部 I/O、狀態管理,但也最容易卡延遲。

- Amdahl 定律:加速某段計算後,整體提升受限於剩餘串列部分,GPU 越快,CPU 調度越像主要延遲來源。

- Pipeline:端到端執行鏈,包含推理、資料預處理、工具呼叫、上下文管理,延遲由最慢環節主導。

- LangChain、LlamaIndex:Python Agent 框架,常見問題是記憶體消耗高、CPU 佔用高、冷啟動慢。

- Rust:系統程式語言,常被拿來對照 Python,在同等功能下更省資源、更利於低延遲。

- Cold Start (冷啟動):從啟動到可服務的時間,Agent 系統常因依賴多、初始化重而放大。

- Token:模型輸入輸出單位,多 Agent 場景常出現重複 Token,協調成本壓過實際推理。

- O(n²):協調成本隨 Agent 數量平方成長,Agent 越多,管理開銷越快失控。

- Agentic Processing:代理程式處理,指 Agent 在生產環境中反覆進行推理、解析輸出、決策下一步、呼叫工具的處理模式。

- NVLink-C2C (Chip-to-Chip):晶片對晶片互連,提供高頻寬、低延遲,支援 CPU、GPU 快取一致性記憶體存取。

- SOCAMM (Server Compression Attached Memory Module):伺服器壓縮附加記憶體模組,主打更高頻寬、更高效能的記憶體封裝路徑。

- CI/CD (Continuous Integration/Continuous Deployment):持續整合/持續部署,自動化整合程式碼、發佈到生產環境的工作流程。

- TEE (Trusted Execution Environment):受信任執行環境,在硬體隔離區執行敏感工作負載,降低未授權存取風險。

- Confidential Compute (機密運算):以 TEE 為核心,讓資料在處理過程中維持保護狀態,提高雲端運算安全性。

- Olympus Cores:NVIDIA 基於 Arm 架構客製化的 CPU 核心,用於提升 CPU 端的調度、資料搬運能力。